生成AIガバナンスにおいて「公平」をどう考えるか――良心回路という試論

マーケティングの領域でも、生成AIの利用は一気に広がってきた。実務やリサーチに携わっていると、その便利さに驚かされる場面は確かに多い。その一方で、どこまで任せてよいのか、どこで人間が踏みとどまるべきなのか、迷いが深くなるのも事実である。

今年度の総務省・経済産業省による「AI事業者ガイドライン」更新版でも、AIの便益だけでなく、その利用に伴うリスクがより具体的に整理されている。AIは、業務の効率化や知見の拡張に寄与する一方で、もっともらしい誤りを生み、既存の偏りを増幅し、判断の過程を見えにくくすることがある。重要なのは、AIを導入するかどうか以上に、AIに何を任せ、何を任せず、どこに人間の判断を残すかを設計することだろう。

そこで避けて通れないのが「公平」という論点である。公平は、AIが自動的に実現してくれる中立性ではない。どの違いを考慮し、どの不利益を補正し、何を妥当とみなすか。そこにはどうしても人間側の価値判断が入り込む。だからこそ、AIガバナンスを考えるとは、AIの性能や利便性を論じることでは終わらない。私たち自身が何を公平と呼び、どこで立ち止まり、何を人間の責任として引き受けるのかを問い直すことでもある。

公平と平等

「公平」について考えていきたい。

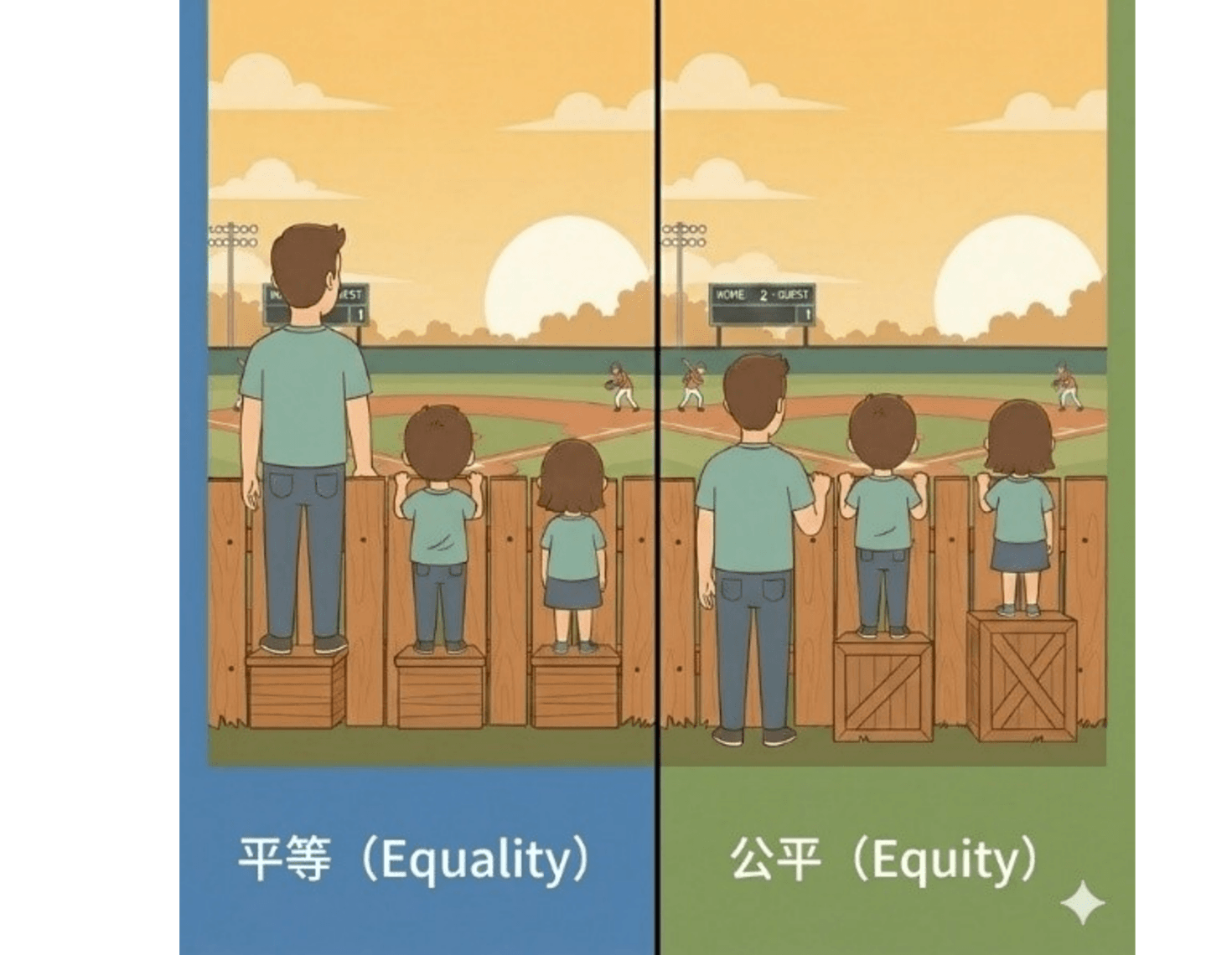

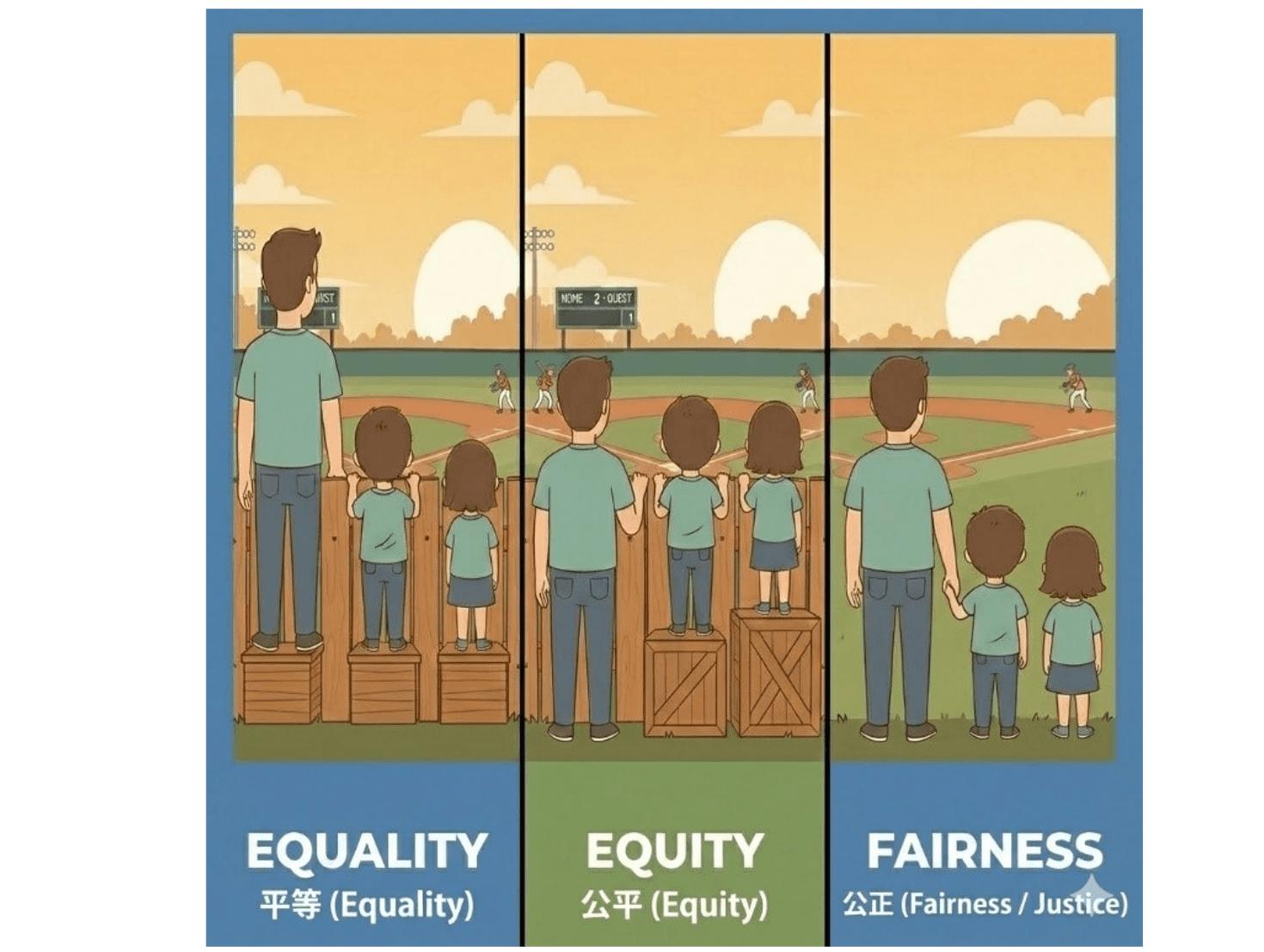

まず、「平等」と「公平」は図でも示したように、しばしば対比的に説明される。もちろん厳密にはさまざまな議論があるが、本稿では実務上の違いを見やすくするため、ひとまず次のように整理しておきたい。

平等(Equality)とは、全員に同じものを与えること。スタート地点や個人の特性を問わず一律に扱うため、機会の提供は同じでも、結果に格差が残ることがある。

公平(Equity)とは、人によって異なる障壁やニーズを考慮し、必要に応じて支援や調整を行うこと。画一的な配分ではなく、実質的な到達可能性をそろえようとする考え方である。

公平が突きつける実務の壁

多くの議論では、スタート地点の異なる人々に合わせてリソースを配分する「公平」が望ましいとされる。しかし、これをそのままビジネスやシステムの現場に実装しようとすると、難しさが一気に増す。

個々のニーズや障壁を細かく把握しようとすれば、年齢、収入、家庭状況、属性など、センシティブな個人情報に踏み込む必要が出てくることがある。だが、その把握自体がプライバシー侵害や新たな差別のリスクを伴う。さらに、何をもって「公平な調整」とみなすかには、どうしても価値判断が入り込む。

もちろん個別の事情に応じた配慮そのものを否定したいわけではない。現実には、一定の配慮や支援が不可欠な場面も多い。ただ、それをAIの自動判断にそのまま委ねることには、別種の危うさがある。個別最適化としての「公平」を追求することは、実務上も倫理上も、想像以上に重い課題なのである。

ここで視点を少し広げてみたい。AI規制の国際的な議論では、個別の調整だけでなく、システム全体としての透明性、説明可能性、監査可能性をどう確保するかが重視されている。少なくとも私には、EU AI Act もまた、個々人への補正としての「公平」だけでなく、制度や構造の側に求められる「公正」に重心を置いているように読める。

日本語では Fairness が「公平」と訳されることも多いが、本稿ではあえて、個別調整としての Equity と、構造や手続の妥当性としての Fairness を少し分けて考えてみたい。 先ほどの図に Fairness を加えてみる。ここでイメージしているのは、「そもそも壁が存在しない状態」である。本質的には、平等でも公平でもなく、その前提を支える“公正な構造づくり”を目指すという考え方である。

平等・公平・公正の整理

ここで、いったん用語を実務的に整理しておきたい。

平等(Equality):全員に同じものを配る

公平(Equity):人によって異なる壁や困難を考慮し、必要に応じて支援を調整する

公正(Fairness):判断や配分の前提となる仕組みや手続を、説明可能で検証や見直しができるものにする。

もちろん、これは厳密な定義というより、本稿の議論を進めるための整理である。

多くの議論では「公平」が望ましいとされるが、実務に落とすと測定コストも倫理リスクも大きい。だからこそ近年は、個別最適化の巧拙だけでなく、システム全体の透明性、説明可能性、監査可能性をどう整えるか、すなわち「公正な構造」をどう作るかが重視されている。

データ活用における公平・公正とは

生成AIの利用範囲は広いが、ここではAIを使ったデータ活用に絞って考えたい。データ活用は大きく、収集・分析・実行の3段階に分けて捉えることができる。

収集 → 分析 → 実行

収集段階では、まず現実をできるだけ正確に捉えることが重要である。たとえ現実の中に偏りや不均衡が含まれていたとしても、それを見えなくしてしまえば、適切な判断の出発点を失う。一方で、どのデータが取れていて、どのデータが取れていないのか、どこに限界があるのかも同時に示す必要がある。

分析段階でも、正確さと限界の明示は重要である。ただし、ここでも価値判断が完全に消えるわけではない。何を指標にするか、何を説明変数とみなすか、どの補正を行うかの時点で、すでに人間の判断は入っている。

そのうえで、特に強い意味で公平・公正が問われるのが実行段階である。なぜなら、そこで初めて、分析結果が具体的な配分、排除、優先順位づけとして人に作用するからだ。効率を重視するあまり、過去の不利益をそのまま再生産してしまう危険は、この段階で最も大きくなる。

AI運用に不可欠な「地図」と「ハンドル」の分離

この違いを、あえて「地図」と「ハンドル」に分けて考えてみたい。

1.測定・分析は、ありのままを映す「地図」

データの収集や分析では、現実をできるだけ正確に把握することが出発点になる。たとえ現実が好ましくないものであっても、それを勝手に理想化してしまえば、判断の前提を失う。地図から崖を消してしまえば、安全な道筋はむしろ見えなくなるからだ。もっとも、地図は現実そのものではない。何が描かれ、何が描かれていないのか、その限界まで含めて見ておく必要がある。

2.実行は、理想へ向けて舵を切る「ハンドル」

一方、AIが実際に判断を下す実行段階では、単に過去をなぞるだけでは足りない。過去の差別的な傾向や不利益、たとえば特定の属性の人が機会を得にくかったり、ある集団に不利な扱いが繰り返されてきたりした履歴を、そのまま「効率的な正解」としてなぞってしまえば、AIは簡単に差別的な方向へとハンドルを切ってしまう。だから必要なのは、データに従うことそのものではない。データを踏まえたうえで、どちらへ舵を切るのかという明確な意志である。

良心回路

ただ、現実の業務では、すべてを人間の熟慮だけで支えるのもまた難しい。だからこそ、人の監督を前提としつつ、その監督を支える補助線のような仕組みが必要になる。現在のAI活用では、この「地図の確認」と「ハンドルの操作」が、実務のなかで十分に分けて意識されないまま一体化してしまうことがある。問題は、AIが勝手に暴走することそれ自体というより、効率や精度の追求のなかで、人間が立ち止まって判断する工程が省かれやすいことだ。だからこそ、公平や公正を守るうえでは、人の意思と監督の介在が前提になる。この点は、現在のAIガバナンスでも一貫して重視されている。

ただし、ここからは少し未来の話になる。人間の監督を前提としながら、その監督を補助する役割の一部をAI自身に担わせることはできないだろうか。私はその可能性を考えるとき、「良心回路」という言葉を使いたくなる。ここで言う「良心回路」とは、単なる禁止語フィルタではない。AIが出した実行案について、特定の属性や集団に系統的な不利益を与えていないか、説明可能な根拠があるか、人間が設定したルールや目的に照らして逸脱がないかを、別系統で点検し、必要に応じて差し戻す仕組みを指している。

具体的には、次のような役割をイメージしている。

歪みの検知(モニタリング):AIが提案した実行案が、過去の偏りや不利益をそのまま再現していないかを点検する。

影響の試算(シミュレーション):効率だけを優先した判断が、特定の人々を不当に排除しないかを事前に確かめる。

差し戻しと修正提案:問題が見つかった場合には、そのまま実行させず、人間の確認や別案の提示につなげる。

重要なのは、この仕組みが最終判断を人間から奪うことではなく、むしろ人間が判断しやすいように立ち止まる契機をつくることである。

「良心回路」という言葉は、石ノ森章太郎氏の『人造人間キカイダー』に由来する。もちろん、現実のAIに人間の良心そのものを実装できるわけではない。だが、少なくとも、効率だけではなく影響や妥当性を点検し、必要なら立ち止まらせる仕組みを設けることはできるはずだ。

実際、世界のAI研究や実務では、オーバーサイトAIやガードレールAIのように、AIの出力を別の層で監視・制御する考え方が広がりつつある。私の言う「良心回路」も、おそらくはその延長線上にある。人間の良心をそのまま機械に埋め込むことはできないとしても、少なくとも、効率だけで突き進まないための“立ち止まる仕組み”は設計できるのではないか。

問われているのは、AIが公平かどうかだけではない。私たち自身が、何を公平と呼び、どの不利益を見過ごさず、どこで立ち止まるのかを決める覚悟を持てるかどうかである。技術とガバナンスを丁寧に設計するとは、結局のところ、その覚悟を仕組みに落とし込むことなのだと思う。

転載・引用について

◆本レポートの著作権は、株式会社インテージが保有します。

下記の禁止事項・注意点を確認の上、転載・引用の際は出典を明記ください 。

「出典:インテージ 「知るギャラリー」●年●月●日公開記事」

◆禁止事項:

・内容の一部または全部の改変

・内容の一部または全部の販売・出版

・公序良俗に反する利用や違法行為につながる利用

・企業・商品・サービスの宣伝・販促を目的としたパネルデータ(*)の転載・引用

(*パネルデータ:「SRI+」「SCI」「SLI」「キッチンダイアリー」「Car-kit」「MAT-kit」「Media Gauge」「i-SSP」など)

◆その他注意点:

・本レポートを利用することにより生じたいかなるトラブル、損失、損害等について、当社は一切の責任を負いません

・この利用ルールは、著作権法上認められている引用などの利用について、制限するものではありません

◆転載・引用についてのお問い合わせはこちら